(相关资料图)

(相关资料图)

新智元报道

编辑:编辑部

【新智元导读】有了这个实在的Agent小助手,文秘小帅的办公流程,简直叫一个行云流水。

最近,有了一个神秘助手的小帅,办公效率比过去提高了十倍不止。

今天,他需要把销售人员的销售金额做个排序,再把清单通过钉钉发给张总。

不用多费口舌,小助手立马准确读取了小帅的需求。

随后,小助手干脆利落地给自己列出了行动计划,不到一分钟,销售金额从高到低排序的清单,就赫然出现在了桌面上。

然后,小助手打开钉钉,自动选定了发送对象——张总,然后把清单发送了出去。

这行云流水的一套流程,简直让人看呆了。莫非《钢铁侠》中的贾维斯AI助理成真了?

你说,PC做——AI开启人类办公新篇章

在介绍这位神秘助手的身份之前,我们先回顾一下,77年前的人类,是怎样使用电脑的。

时间回到1946年,世界上第一台计算机ENIAC诞生。连接一堆线缆、切换一堆开关,就是人类历史上首次使用电脑的方式。

77年后的今天,ChatGPT的诞生颠覆了人类社会。GPT-4、PaLM、Llama等大模型的相继爆发,让AI迎来了历史性的「iPhone时刻」。

微软办公Office 365接入GPT-4,PaLM整合进谷歌Workspace。AI大模型的诞生和崛起,让打工人的办公场景发生了根本性变革。

最近爆火的智能体Agent,更是让贾维斯、《科幻世界》中的机器人小秘书和《星际穿越》中的「塔斯」(Tars)机器人,从科幻走进现实。

正如开头所演示的,我们只要动动嘴,电脑就能自己动起来,让原本枯燥繁琐的工作摇身一变,成为——「你说,PC做」。

而这位能够「听得懂,想明白,看得见,动起来」的数字助理,便是实在智能发布的业内首款基于大模型的Agent产品TARS-RPA-Agent,也叫ChatRPA。

它不仅能够理解人类的意图,还能操作所有桌面软件,包括各种复杂的CS架构软件,甚至对不开放接口的软件也能操作。

在CV大模型ISSUT(智能屏幕语义理解技术)的加持下,TARS-RPA-Agent就像戴上了酷炫的屏幕洞察眼镜,眨眼间就能秒懂屏幕上的一切。

甚至,不仅是在电脑上,任何屏幕(比如车载平板)都可以实现这个操作。

举个例子,这意味着,后续在汽车环境下,除了当下已通过接口方式实现对所有车载设备进行控制,如控制车窗空调、播放音乐、导航等简单操作之外,还可以通过语音指令轻松指挥车载平板上所有的软件APP(如钉钉、微信、甚至是WPS、美图秀秀等)自动完成各种复杂工作任务。

可以说,TARS-RPA-Agent成就的是更加科幻感满满的未来,促进人类实现真正的人机协同。

在未来,人类与电脑/手机的协同方式一定是让技术适应人,而非人适应技术。产品也不再是以系统为中心,而是以人为中心。

在这种全新人机协同模式下,AI将更加智能化、人性化。

与此同时,人类也不用花费大量时间去学习如何操作一个新的应用或工具,而Agent可以理解我们的需求和习惯,做出调整。

这意味着,当AI从一个被动工具,变为一个智能助手,将会更加重视我们的习惯,确保在执行任务要求同时,为人类创造出更加人性化的体验。

想让Agent替你打工?层层难关需攻克

然而,这项划时代性技术,需要克服的困难,远比我们想象的要多。

尤其是,想要让AI Agent在行业中发挥出真正的商业价值,更非易事。

当你要求Agent帮自己请假时,大模型虽然能做到「理解意图」,但要操作像钉钉这种没有可解析的网页源代码,或可调用的API接口的应用时,还需要另寻它法。

相比之下,RPA可以模拟人类行为的方式,对电脑软件完成操作。由此可见,大模型+RPA方式是执行如上帮你请假等任务的一种必然模式。

但随之而来的另一个问题是,传统的RPA由于不能对软件页面进行精准识别,比如哪个是输入框,哪个是登录入口等等,在面对诸多任务时也还是会一筹莫展。

而当前计算机视觉CV大模型的发展,能够为此提供一种解决方案,让RPA在执行任务时「看见」操作页面,秒懂屏幕画面。

接下来,在解决了接口调用、图像理解这两个问题之后,AI Agent还需要突破四大难关,才能成为真正意义上的「数字员工」:

「能否自主拆解任务、能否感知当前环境、能否执行并且反馈、能否记忆历史经验。」

1. 如何轻松实现任务的自主拆解?首先,在实际的场景中,人类给出的指令是非常复杂的,但所用的语句却非常简洁。如何从蕴含庞杂信息和逻辑命令的指令中,理解并拆解任务是非常难的。

比如「订一张明天到上海的高铁车票」,就涉及到数量「一张」、时间「明天」、行程「到上海」、目标「买高铁票」。

想要最终完成这个任务,就要求Agent必须能够理解指令,并将其拆解成可执行的子任务和步骤。比如,登录购票网站、查询余票信息、完成车票预订等多个步骤。

2. 如何实现任务元素的精准定位?除了要把任务分解成可执行的子模块外,Agent还必须知道自己是谁、在哪。

比如,订明天的票,就意味着Agent需要知道今天是几号;有了终点上海,也需要知道自己所处的起点是哪个城市。

与此同时,Agent还需要对周边的环境有充分的认知、理解和交互。

还是以刚刚的购票任务为例,要完成「登录购票网站」这一步,就需要Agent明确地知道,账号输入、密码输入,以及登录按钮分别在屏幕上的什么位置。

3. 错误会不断积累,需要及时去更正在执行任务时,人类会随时关注进度,并通过不断的「执行-反馈-修正」来确保任务的正常进行。

对于Agent来说,同样需要保证每一步操作的正确性,不会因为领会错了意图,或者前一步操作失误,而导致当前步骤点错按钮、输错账号或者发错邮件。

最好是还能够进行单步寻优,并且把每一步的执行过程和结果都展示和反馈出来。

4. 解决长时记忆,实现自主迭代能力最后,Agent还需要具有从经验中学习,并通过历史案例不断能提升自己决策的能力。

特别是在人类的帮助下完成一项任务之后,可以在下次遇到同样的任务时,自己去正确地执行。

举个例子,为了解决这个困扰大模型已久的长时记忆问题,AutoGPT选择的就是利用内存管理的手段,来实现上下文保留和决策优化能力。

AI Agent时代的爆款:TARS大模型智能助理

面对这一系列的挑战,实在智能创新性地把CV大模型(ISSUT)、LLM(TARS大模型),以及RPA整合在了一起,并通过不同的技术、设计和方法解决了上述难点。

由此诞生的TARS-RPA-Agent,也成为了一个能够自主拆解任务、感知当前环境、执行并且反馈和记忆历史经验的超自动化智能体。

在TARS-RPA-Agent的加持下,对于发邮件这种基本操作,你只需要在对话框中,输入「使用163邮箱给×××发送邮件,说你好」即可。

接下来,TARS-RPA-Agent将这个描述的请求拆解为2个步骤。第一步:打开163邮箱;第二步:登录邮箱发送邮件。在每个计划中,都包含了详细的执行步骤。

确认无误后,直接点击「执行」,就能看到TARS-RPA-Agent嗖嗖嗖,开始扫描页面,完成给定的任务。

除了发邮件,诸如请假等各种办公场景,TARS-RPA-Agent也全能覆盖,而且还有着优秀的泛化能力。

比如,当你想买一款笔记本电脑,但又不知道选哪款比较好时,就可以问Agent「京东上最畅销的笔记本电脑是什么」。

很快,Agent就给自己定出了行动计划,然后根据我们的需求,自己登入京东进行搜索排序,并进入第一个结果的详情页。

值得一提的是,TARS-RPA-Agent还考虑到了现有的Agent容易陷入死循环并消耗大量tokens的问题,在任务过程中可允许人工修改、调优等,在产品上能够更好地支持人机协同操作。

比如,遇到不能执行的步骤,我们只需动动嘴,或者点击页面的元素,就能让它自动创建后面的流程,基本上无需人类操作就能完成。

另外,如果这过程中我们有了新的计划,直接用嘴告诉TARS-RPA-Agent就可以。

在记录下选中的产品信息之后,还会贴心地帮你保存下来。

以往,这些功能都得需要在已有组件上去做各种形式的流程实现,不仅复杂,而且难度高。

而现在,有了TARS大模型的加持,直接让TARS-RPA-Agent拥有「遇河搭桥」的能力。即便是没有可调用的组件,TARS-RPA-Agent也能够直接生成一个组件,让整个工作流畅通无阻。

对于那些没有编程能力的人来说,无疑是释放了生产效能。

不仅如此,在大模型的加持下,同样的操作也可以轻松泛化到其他平台上。而这一点的实现,只需要你把「京东」这两个字换成「淘宝」就可以了。

此外,在流程执行结束后,也还可以继续对话,并增加新的执行计划来完成流程能。

这些看起来十分简单的操作,实际上体现的是TARS-RPA-Agent三种强大的能力——视觉识别、逻辑推理,和代码生成。

首先,TARS大模型本质上是一个语言模型,能够分析推理,却「看不到」要执行的对象。但有了ISSUT视觉技术的加持,它就像是有了一双眼睛,能够进一步操作对象,驱动RPA去创建整个流程。

其次的逻辑推理能力,让TARS-RPA-Agent能够将各个组件变量的逻辑关系进行串联。

而代码生成能力,则是让它可以在没有基础组件的流程步骤中直接生成一段代码,封装成自建组件,在之后可以随时调用。

基于此,用户只需动嘴提出需求,Agent就能自动拆解任务,根据屏幕语言理解,够完成实时流程搭建和执行。

可以说,实在智能的TARS大模型在超自动化场景与Agent的融合和应用,是国内企业向大模型Agent场景化应用创新迈进的重要一步。

并在最终,实现人类意图的超越,成为驾驭桌面的终极力量。

「Agent」:AI引领下的下一个人机协同前沿

要知道,时间不是衡量伟大技术创新的标准,有时候,速度才是真正的量尺。

当今LLM(大语言模型)最主要的能力体现在,处理和生成内容。但结果的生成,需要以输入作为前提。

在当前快速发展的背景下,LLM仅仅满足于其拥有的聊天、创作、绘画、社交等功能是远远不够的。

而Agent作为一种能够感知环境,做出决策的智能体,则可以在循环中运行,生成自我导向的指令和操作,不依赖人类来指导对话,更加足以让人放开想象。

由此,我们可以让LLM去充当Agent的「大脑」。通过LLM和Agent的结合,能够让AI自动化处理更加复杂的任务。

如此一来,Agent智能助手就可以变身一个「数字打工人」,让我们工作效率大大提升,最终为人类提供更多的实用价值。

而这,也是大模型下一阶段的必然发展方向。

为了扩展LLM的应用,国外的研究人员提出了以AutoGPT,GPT-Engineer和BabyAGI等项目为代表的全新形式——集成大语言模型的Agent。

通过将大语言模型作为Agent的核心大脑,就可以实现复杂任务的分解,并在每个子步骤实现自主决策,无需用户参与即可解决问题。

比如,今年4月爆火的Auto-GPT,现在已经在GitHub上狂揽了147k星。

这个项目的意义在于,Auto-GPT就像是给GPT-4模型装了一个身体。在接到用户提交的任务之后,自己就能提出并执行相应的计划。不到5分钟,一个网站就搭建好了。

接入GPT-4大模型的GPT-Engineer也是同样的原理,只需动动嘴,给出一个提示,开发者就可以构建整个代码库。

然而,这些新晋顶流的Agent却有着不少自身的局限性,比如使用GPT-4 API费用高昂、需要一定的编程基础、应用范围也相对较窄。

甚至,因为GPT-4固有的局限性,比如胡说八道、犯推理错误,有时也会导致Auto-GPT等并不可靠。

除了学术上的探索外,在硅谷,已经有人找出了让Agent商业化落地的答案。

今年3月,由前OpenAI工程副总裁成立的初创企业Adept,一举狂揽3.5亿美元融资,除了General Catalyst和Spark Capital联合领投,还有众多机构和硅谷明星创业者跟投。

简单来说,Adept创造了一个名为Action Transformer(ACT-1)的「AI队友」,能够将文本命令转化为一系列行动。

比如,通过连接到Chrome浏览器的扩展程序,在人类的提示下进行某些操作,或者与Salesforce和电子表格配合,以往需要点击10次以上的复杂操作,一句话即可完成。

业界首家推出大模型Agent的公司

虽然,必须借助API才能实现软件调用的形式极大地限制了ACT-1的使用场景,但Adept依然拿到了强有力的融资。由此也可以看出,行业内对Agent办公的强大信心,和这种趋势的一致认可。

现在,随着技术的进一步发展,AI Agent更是成为了业界公认LLM落地的有效方式之一。

而国内公司的脚步,自然也没有落下。

作为国内首家推出大模型Agent的企业,实在智能才成立5年,就荣誉傍身。

连续3年获评AI准独角兽企业,通过国家高新技术企业及CMMI-5全球软件成熟度最高级别认证(全球不到1800家),拥有200余项独立自主知识产权、实际授予的发明专利53项,位列行业第一。

数十人的高水平算法团队,NLP、CV、以及OCR技术在国内均为第一梯队。

实在智能不断蝶变创新的背后,是技术研发实力深厚的体现,以及倍增的实际效益。

2020年,这家公司首次推出了RPA产品,并在业界首次提出「融合拾取」技术,让RPA拾取精度实现跨越式发展。

2022年,智能屏幕语义理解技术ISSUT的发布,让RPA戴上了「眼镜」,从「拖拉拽」过渡到「点选用」。这种更新的IPA模式,也让原本门槛极高的RPA工具变得人人可用。

2023年,实在智能凭借技术沉淀,再一次引领创新,将计算机视觉和大模型结合,推出TARS-RPA-Agent,这在全球的Agent领域也是不多见的,更是RPA领域的首创。

实在智能之所以选择Agent作为产品的下一个发展方向,就是因为人工智能生成为驱动管理系统提供了一种全新的方式,可以直接生成并执行各种可操作的业务流程。

通过整合AIGC,产品能够实现智能化,并为B端用户提供高效、可执行的解决方案。其中,LLM如果与企业管理软件融合好,大模型便能顺利落地。LLM的私有化部署能力,往往意味着厂商们更大的商机。

而TARS-RPA-Agent所依赖的LLM——实在智能的自研垂直TARS大模型,具有优异的文本生成、语言理解、知识问答、逻辑推理等核心能力。

在TARS大模型的加持下,一种全新的「TARS + X」模式应运而生。

如今,我们可以看到,ChatRPA为超自动化产品矩阵带来的变革升级,让未来办公「只动嘴不动手」。

与此同时,实在智能的首款和文档对话的产品Chat-IDP,也开创了文档交互、文档处理的新模式。

基于OCR+NLP的「智能文档审阅」IDP产品,更是已经达到全国领先,广泛应用于金融、教育、工业等各个行业。

从2023年开始,我们使用的电脑的方式,或将被这家起步虽晚但技术雄厚、带领行业弯道超车的AI准独角兽改变。

构建洛邑古城数字文旅新高地|区委书记、区长赵书政带队参观AIRLOOK

构建洛邑古城数字文旅新高地|区委书记、区长赵书政带队参观AIRLOOK

表里山河 能动华夏 ——《中国国家地理》推出能源山西特辑

表里山河 能动华夏 ——《中国国家地理》推出能源山西特辑

楼阳生到省科学院调研

楼阳生到省科学院调研

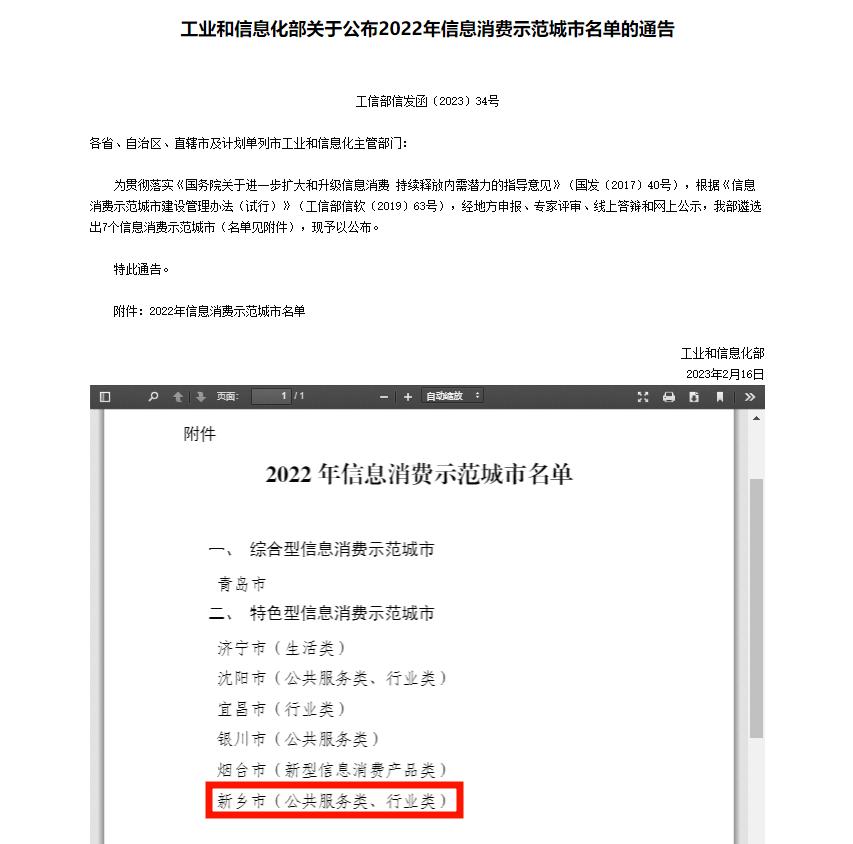

全省唯一!新乡市成功获评国家特色型信息消费示范城市

全省唯一!新乡市成功获评国家特色型信息消费示范城市

河南省第九届少数民族传统体育运动会4月22日开赛

河南省第九届少数民族传统体育运动会4月22日开赛